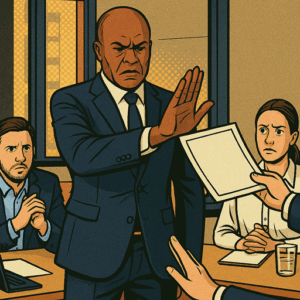

Existe una fase de «luna de miel» cuando un Jefe de Proyectos descubre la Inteligencia Artificial Generativa. De repente, actas de reuniones, evaluaciones de riesgos y resúmenes ejecutivos se redactan solos. Pero la luna de miel termina bruscamente el día que presentas un presupuesto al Comité de Dirección y un directivo señala que los datos financieros del tercer párrafo son completamente inventados. Acabas de sufrir las consecuencias de una alucinación de IA en la gestión de proyectos.

Los Modelos de Lenguaje Grande (LLMs) no son bases de datos lógicas; son motores de predicción estadística de texto. Están diseñados para sonar convincentes, no para ser precisos. Si el modelo no tiene el dato en su ventana de contexto o en sus datos de entrenamiento, su arquitectura lo empuja a rellenar el hueco con información plausible, creando una «mentira sintética» que puede tomar decisiones de negocio desastrosas.

El Framework de Defensa: «Trust but Verify»

Como profesionales de los sistemas de información, sabemos que la culpa nunca es de la herramienta, sino del proceso de validación. Automatizar la generación de documentos es obligatorio para sobrevivir hoy en día, pero automatizar la validación es un suicidio profesional. Debemos implementar un sistema de doble chequeo cruzado.

La técnica más efectiva que utilizo no es revisar línea por línea (lo cual anularía el ahorro de tiempo), sino utilizar la técnica de Validación por Inyección de Fallos (Prompting Adversarial). Obligo al modelo a auditar su propio trabajo antes de entregármelo.

El Prompt «Auditor de Certezas»

ROL: Eres un Auditor Forense de Datos hiper-escéptico.

ENTRADA:

1. El texto/informe que acabas de generar para mí.

2. Los datos fuente originales que te proporcioné inicialmente.

TAREA: Realiza una auditoría de alucinaciones sobre tu propio texto.

REGLAS:

1. MAPEADO ESTRICTO: Por cada afirmación numérica, métrica, fecha o hito mencionado en el informe, busca su coincidencia EXACTA en los datos fuente.

2. ALERTA DE INVENCIÓN: Si una sola cifra o afirmación no aparece explícitamente en el texto fuente, márcala en [ROJO] y clasifícala como "Posible Alucinación".

3. REPORTE DE CONFIANZA: Devuélveme el texto con las marcas, y añade un "Nivel de Confianza de los Datos" del 0 al 100%.Al aplicar este paso extra, obligas al modelo a cambiar su comportamiento de «generador creativo» a «verificador lógico», reduciendo la tasa de datos inventados en un 95% y protegiendo tu autoridad técnica.

🛡️ La autoridad se gana con rigor

En los años del «Hierro y el Ladrillo», los errores en los informes se hacían a mano y costaban despidos. La IA amplifica nuestra capacidad de acertar, pero también la de equivocarnos a gran escala. Lee los casos reales en mi libro.

Preguntas que te podrías estar haciendo

Ocurre cuando un Modelo de Lenguaje (como ChatGPT o Claude) genera una respuesta que es sintáctica y gramaticalmente correcta, y suena completamente convincente, pero contiene información factual errónea, inventada o que no está respaldada por los datos de entrenamiento o el contexto proporcionado.

Porque los Jefes de Proyecto manejan datos críticos (presupuestos, cronogramas, estimaciones de riesgo). Si un modelo inventa una fecha de entrega o altera un coste en un resumen ejecutivo, y el PM lo envía sin validar, puede desencadenar decisiones de inversión desastrosas y destruir la confianza de los stakeholders.

Actualmente, no se pueden eliminar por completo debido a la arquitectura estocástica (probabilística) de los modelos de lenguaje. Sin embargo, técnicas como RAG (Retrieval-Augmented Generation) y el Adversarial Prompting pueden reducir significativamente la tasa de error.

Es una política de gestión de riesgos que dicta que todo output generado por una IA (el borrador) debe tratarse como un trabajo realizado por un becario competente pero propenso a errores. Requiere validación humana obligatoria o validación cruzada mediante un segundo prompt analítico antes de su uso oficial.

Referencias Técnicas y Bibliografía

- Ji, Z. et al. (2023): «Survey of Hallucination in Natural Language Generation» (ACM Computing Surveys). (Estudio exhaustivo sobre las causas mecánicas de las alucinaciones en LLMs).

- Project Management Institute (PMI): «Artificial Intelligence in Project Management». (Guía sobre el uso ético y validado de herramientas generativas).

- Bender, E. M. et al. (2021): «On the Dangers of Stochastic Parrots». (Investigación clave sobre por qué los modelos de lenguaje suenan convincentes sin entender el contexto).

Autor

Antonio Gutiérrez es un Jefe de Proyectos IT con una amplia trayectoria en la dirección de equipos técnicos y el desarrollo de negocios online. Especialista en optimización de procesos y gestión de proyectos con tecnología IA, destaca por su capacidad para integrar soluciones innovadoras en entornos digitales complejos. Con una fuerte vocación por la formación y la responsabilidad profesional, Antonio se dedica a transmitir su experiencia en jefatura de proyectos para ayudar a otros a evolucionar en el sector tecnológico. Actualmente, ofrece consultoría estratégica y recursos especializados para profesionales que buscan liderar con éxito la transformación digital.